GR-2: A Generative Video-Language-Action Model with Web-Scale Knowledge for Robot Manipulation

1. 论文速览

| 阅读定位项 | 紧凑结论 |

|---|---|

| 论文要解决什么 | 在真实机器人数据昂贵、任务和场景变化大的条件下,训练一个能通过语言指令执行多种 manipulation skill,并能迁移到未见场景的通用机器人策略。 |

| 作者的方法抓手 | 先让 GPT-style transformer 在大规模 text-video 数据上预测未来视频,获得环境动态和语义先验;再在机器人轨迹上同时预测未来图像与 action trajectory,并用 WBC 部署到真实机器人。 |

| 最重要的结果 | 在 105 个真实桌面任务 Simple setting 达到 97.7% success rate;bin picking 平均成功率从 GR-1 的 33.3% 提升到 79.0%;CALVIN 5 连任务成功率从 GR-1 的 73.1% 到 85.9%。 |

| 阅读时要注意的点 | 方法的核心不是单纯“用大模型做机器人”,而是把视频生成目标保留下来作为动作预测的伴随任务;同时论文没有公开完整训练超参和代码,复现重点要放在数据规模、tokenization、cVAE action head、WBC 部署接口四处。 |

难度评级:★★★★☆。需要熟悉 language-conditioned robot policy、VQGAN 离散视觉 token、GPT-style autoregressive modeling、conditional VAE action chunking,以及真实机器人控制中的 Cartesian trajectory 到 joint action 的部署链路。

关键词:generalist robot manipulationvideo generative pre-trainingvideo-language-actionaction trajectory predictionwhole-body control

核心贡献清单

- 规模化视频预训练。作者将 GR-1 所用的 0.8M 预训练视频扩大到 38M text-video clips,约 50B tokens;这使模型在机器人 fine-tuning 前先学习“给定文本和当前帧,未来视觉状态应该怎样演化”。

- Video-language-action 联合策略。GR-2 在机器人数据上不是只预测动作,而是同时预测未来多视角图像和 action trajectory;论文把这作为从视频生成知识无损迁移到机器人动作学习的关键结构设计。

- 真实机器人多任务和工业化 bin picking 验证。作者用 105 个桌面任务、94K bin-picking 轨迹、122 个评测物体和 CALVIN benchmark 展示模型的多任务学习、泛化和长序列能力。

- 部署层引入 WBC。模型输出 Cartesian action trajectory,随后通过 trajectory optimization 与 whole-body control 转为 200 Hz low-level joint actions,覆盖真实机器人运行时的平滑、碰撞和 manipulability 约束。

2. 动机

2.1 要解决的问题

论文把目标设定为 language-conditioned visual robot manipulation:人用自然语言给出任务,同一个策略根据语言、历史观测和机器人状态,直接输出未来一段动作轨迹。作者选择语言条件,是因为自然语言是人给机器人指定任务最灵活的接口之一。

现实瓶颈是机器人数据采集成本高、系统扩展慢。一个能做 100 个任务的机器人,如果每个任务都需要大量真实轨迹,数据采集会成为主要限制。论文明确强调 GR-2 在 1/8 数据量,即平均每任务约 50 条轨迹时仍能学习 100+ 任务,这是其“快速适配新任务”的关键动机。

2.2 已有方法的局限

论文从两个方向定位前作局限。第一,许多 generalist robot policy 依赖大规模机器人数据或目标图像、3D 信息、层级规划等专门信号;这些方法能提升任务覆盖,但仍受限于机器人数据规模或部署条件。第二,已有从非机器人域借知识的方法虽然使用 web-scale vision-language 模型或混合数据训练,但作者认为 视频中的环境动态 对 action prediction 尤其重要,因此单纯视觉表征预训练不完全匹配动作学习。

相对于 GR-1,GR-2 的论文内对比更具体:GR-1 已经尝试 video generative pre-training,但预训练视频只有 0.8M;GR-2 扩展到 38M,并且通过新的模型结构让预训练知识在机器人 fine-tuning 时继续参与视频预测和动作预测。

2.3 本文的高层思路

核心 insight 是:如果模型能根据语言和当前视觉状态预测“下一段视觉世界会怎样变化”,那么这个预测出的视觉轨迹可以成为动作生成的隐式计划。GR-2 因此不把视频生成仅当成预训练任务,而是在 robot fine-tuning 阶段继续同时预测未来图像和 action trajectory。

4. 方法详解

4.1 问题定义

论文把策略写成一个语言条件的端到端函数。给定语言指令 $l$、过去 $h$ 步环境观测 $\mathbf{o}_{t-h:t}$ 和机器人状态 $\mathbf{s}_{t-h:t}$,策略输出从当前时刻开始的未来 $k$ 步动作轨迹:

这个公式在说:策略不是预测单步动作,而是根据语言、视觉历史和机器人状态一次性生成一段未来动作。

$$\mathbf{a}_{t:t+k} = \pi(l, \mathbf{o}_{t-h:t}, \mathbf{s}_{t-h:t})$$| $l$ | 自然语言指令,例如 “press the toaster switch”。 |

| $\mathbf{o}_{t-h:t}$ | 历史视觉观测序列;真实机器人中来自 head camera 和 hand camera 两个视角。 |

| $\mathbf{s}_{t-h:t}$ | 机器人状态序列,包括末端执行器位置、旋转和二值 gripper state。 |

| $\mathbf{a}_{t:t+k}$ | 未来一段 Cartesian action trajectory,而不是单个低层关节控制量。 |

4.2 两阶段训练

阶段一:Video generative pre-training。GR-2 是 GPT-style transformer。预训练输入是 tokenized text 和 image sequence,输出是未来图像的离散 token;这些 token 再由 VQGAN decoder 解码成未来帧。预训练数据由作者整理的 38M video clips 组成,约 50B tokens,来源包括 HowTo100M、Ego4D、Something-Something V2、EPIC-KITCHENS、Kinetics-700,以及 RT-1、Bridge 等公开机器人数据。

阶段二:Robot data fine-tuning。fine-tuning 时,GR-2 的输出变成未来图像和动作轨迹的联合预测:

这个目标把“想象未来视觉状态”和“执行动作”绑定在同一个模型里。

$$\pi(l, \mathbf{o}_{t-h:t}, \mathbf{s}_{t-h:t}) \rightarrow \mathbf{o}_{t+1}, \mathbf{a}_{t:t+k}$$| $\mathbf{o}_{t+1}$ | 未来图像;在多视角机器人数据中,每个视角都要预测未来图像。 |

| $\mathbf{a}_{t:t+k}$ | 由 conditional VAE 生成的 action trajectory。论文说经验上轨迹生成比单步动作对平滑性和实时性能更关键。 |

4.3 输入编码和输出头

- 语言:使用 frozen text encoder 对指令编码;论文引用 CLIP text encoder。

- 图像:使用 VQGAN 把每帧图像转换成离散视觉 token;VQGAN 在互联网数据和机器人域数据上训练,并在训练过程中冻结。

- 机器人状态:末端执行器 position、rotation 和 gripper state 通过可训练 linear layers 编码。

- 动作:action trajectory 由 conditional VAE 生成,支持动作多模态和 chunked prediction。

4.4 真实机器人部署

硬件系统是 7-DoF Kinova Gen3 机械臂和 Robotiq 2F-85 gripper,配两个相机:静态 head camera 提供工作区整体视角,end-effector camera 提供夹爪附近交互视角。GR-2 输出 Cartesian trajectory 后,作者使用 Whole-Body Control 算法执行轨迹优化和实时运动跟踪。该过程把轨迹平滑性、连续性、collision constraints 和 manipulability 纳入优化,并以 200 Hz 执行低层 joint actions。

5. 实验与结果

5.1 实验设置总览

| 实验 | 数据/任务 | 评估目标 | 关键数字 |

|---|---|---|---|

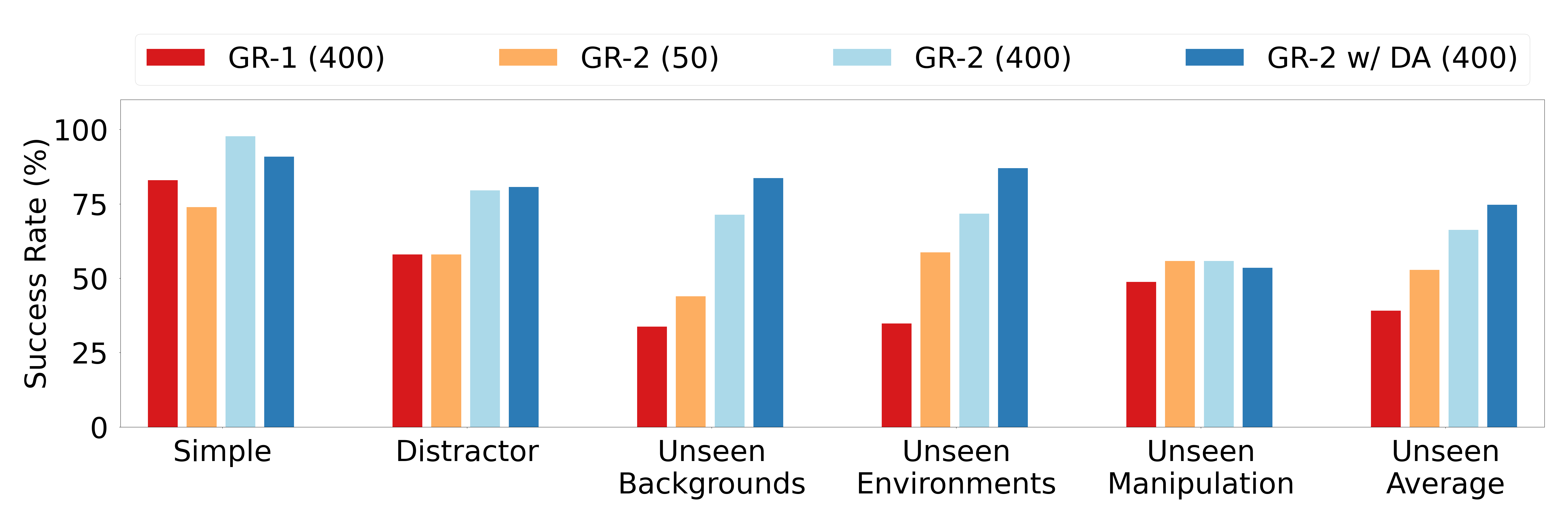

| Real-world multi-task learning | 105 个桌面任务,8 类 skill;约 40K teleoperation trajectories,平均 400 条/任务;另有 1/8 数据版本约 50 条/任务。 | 多任务学习、干扰物鲁棒性、未见背景/环境/操作泛化。 | Simple setting 97.7%;Unseen Backgrounds 71.4%;Unseen Environments 71.7%;Unseen Manipulation 55.8%。 |

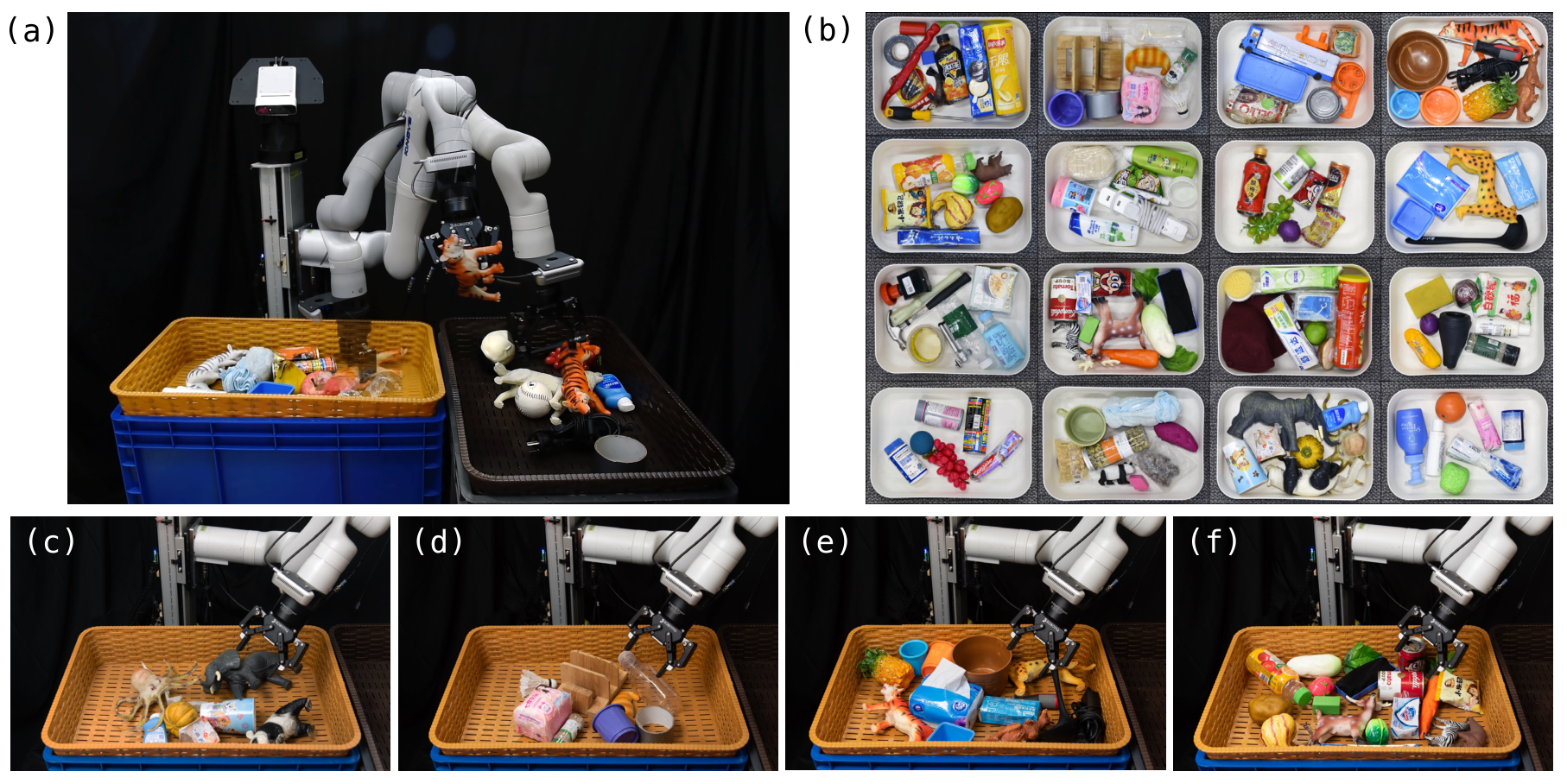

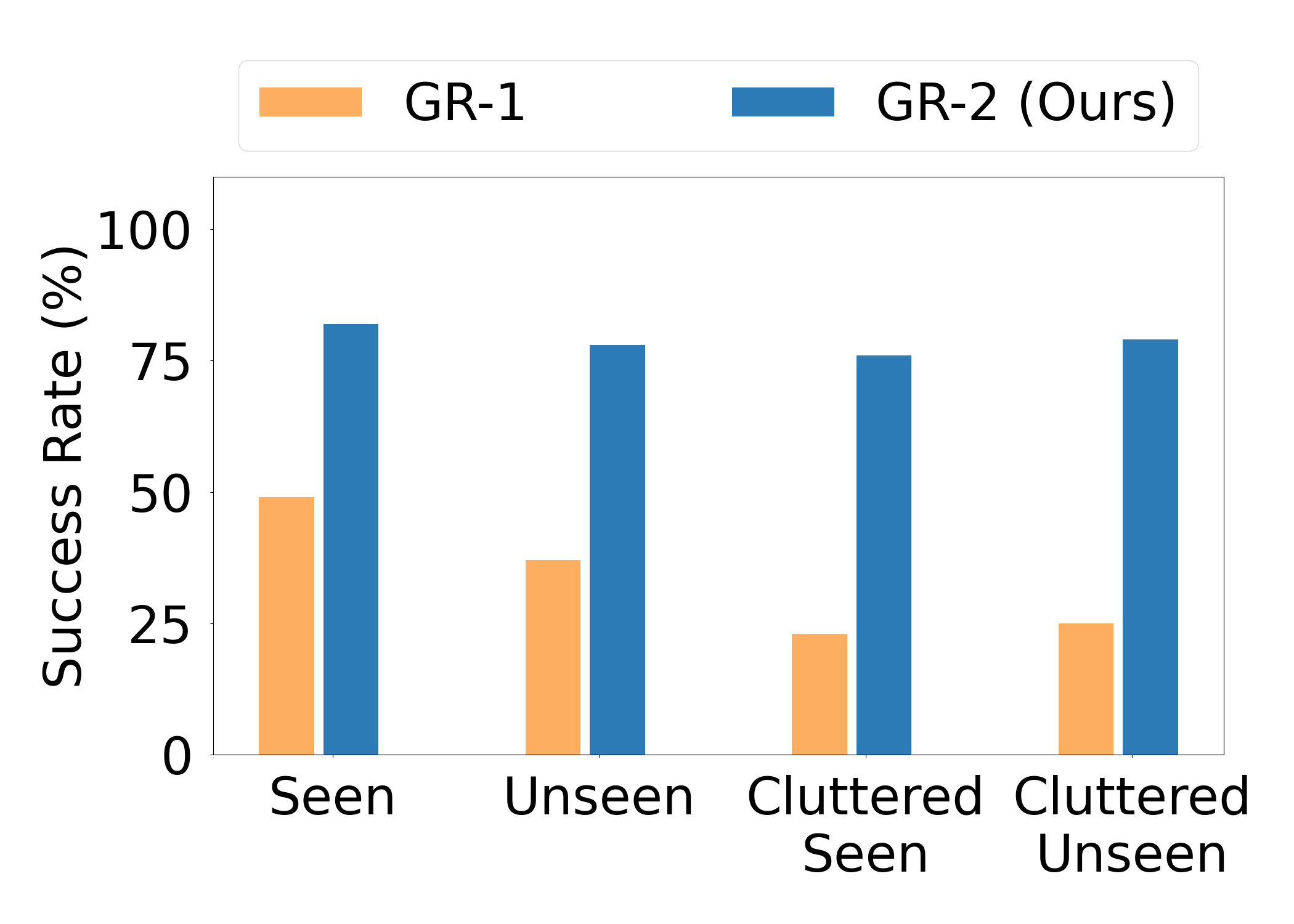

| End-to-end bin picking | 55 个训练物体,约 94K pick-and-place trajectories;评估 122 个物体,其中 67 个训练未见。 | 工业式混杂物体抓取,seen/unseen/cluttered 泛化。 | 平均 success rate 从 GR-1 的 33.3% 到 GR-2 的 79.0%。 |

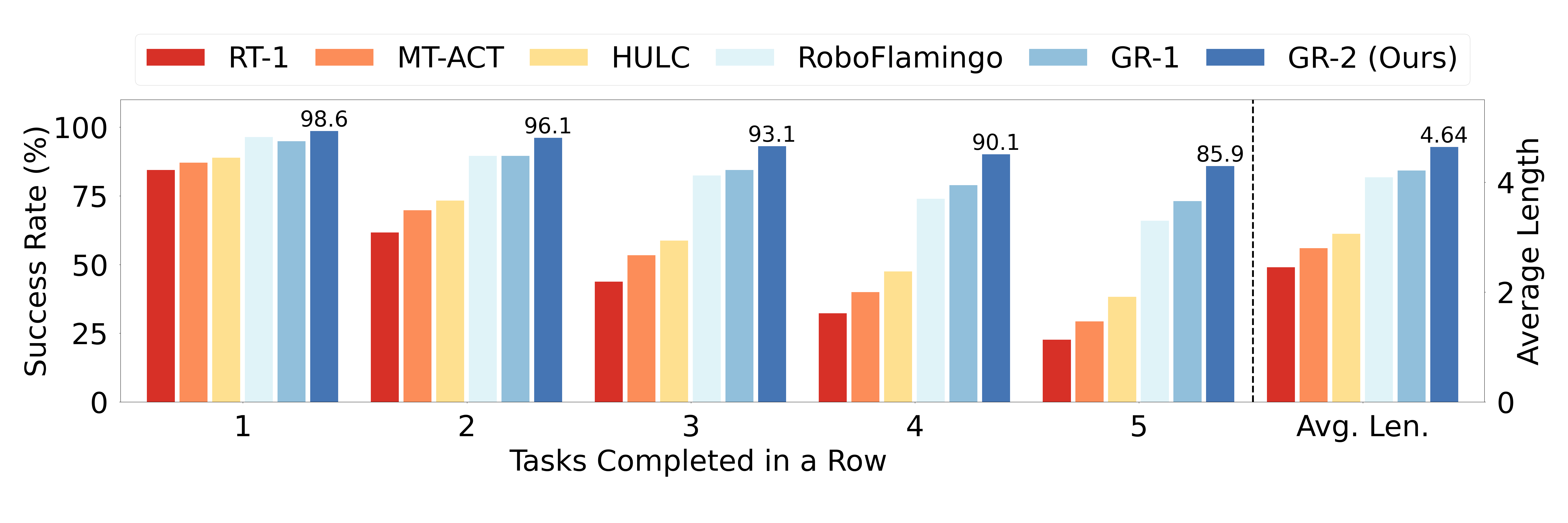

| CALVIN benchmark | ABCD-D split,34 个任务,20K+ demonstrations;1000 个 5-task instruction chains。 | 模拟长序列语言条件操作。 | 1-task success 98.6%;5-task success 85.9%;average length 4.64。 |

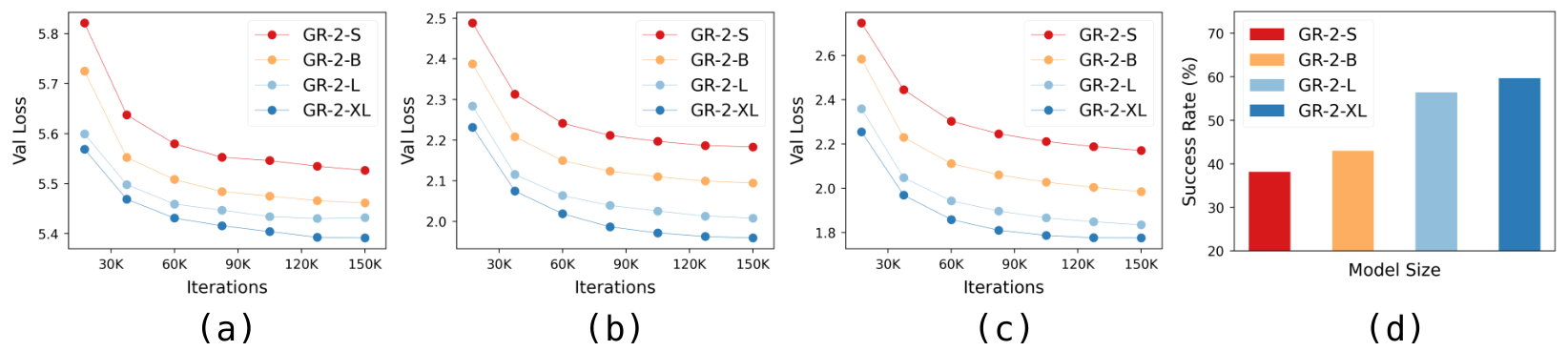

| Scaling | GR-2-S/B/L/XL 四种规模。 | 预训练 video loss 与真实机器人 success rate 是否随模型规模改善。 | trainable parameters 为 30M、95M、312M、719M;默认 GR-2 总参数 230M,其中 95M trainable。 |

5.2 Real-World Multi-Task Learning

任务覆盖 picking、placing、uncapping、capping、opening、closing、pressing、pouring 八类 skill。作者还在 fine-tuning 中做数据增强:插入新物体时训练 diffusion model,并结合自采物体数据和 Open Images;改变背景时用 SAM 分割背景,再用 video generation model 生成保持机器人运动的 augmented video。

论文强调的失败案例主要出现在 Unseen Manipulation:模型可能无法抓取新形状的未见物体,或在指令要求抓取未见物体时选错目标物体。这一失败模式也被作者在未来工作中指向“提升 unseen manipulation 的泛化和鲁棒性”。

5.3 End-to-End Bin Picking

bin picking 任务使用固定语言指令 move any object from the right basket to the left basket.。训练阶段有 55 个物体、约 94K 轨迹;评测阶段包含 122 个物体,分为 Seen、Unseen、Cluttered Seen、Cluttered Unseen 四种设置。Cluttered 设置把源篮中物体数量增加到训练设置约两倍,因此即使物体 seen,也构成分布外密度。

5.4 CALVIN Benchmark

CALVIN 评估长序列语言条件操作。作者在 ABCD-D split 上测试 1000 条 instruction chain,每条要求连续完成 5 个任务。GR-2 与 RT-1、MT-ACT、HULC、RoboFlamingo、GR-1 对比,论文报告其 1-task success 从 GR-1 的 94.9% 到 98.6%,5-task success 从 73.1% 到 85.9%,average length 从 4.21 到 4.64。

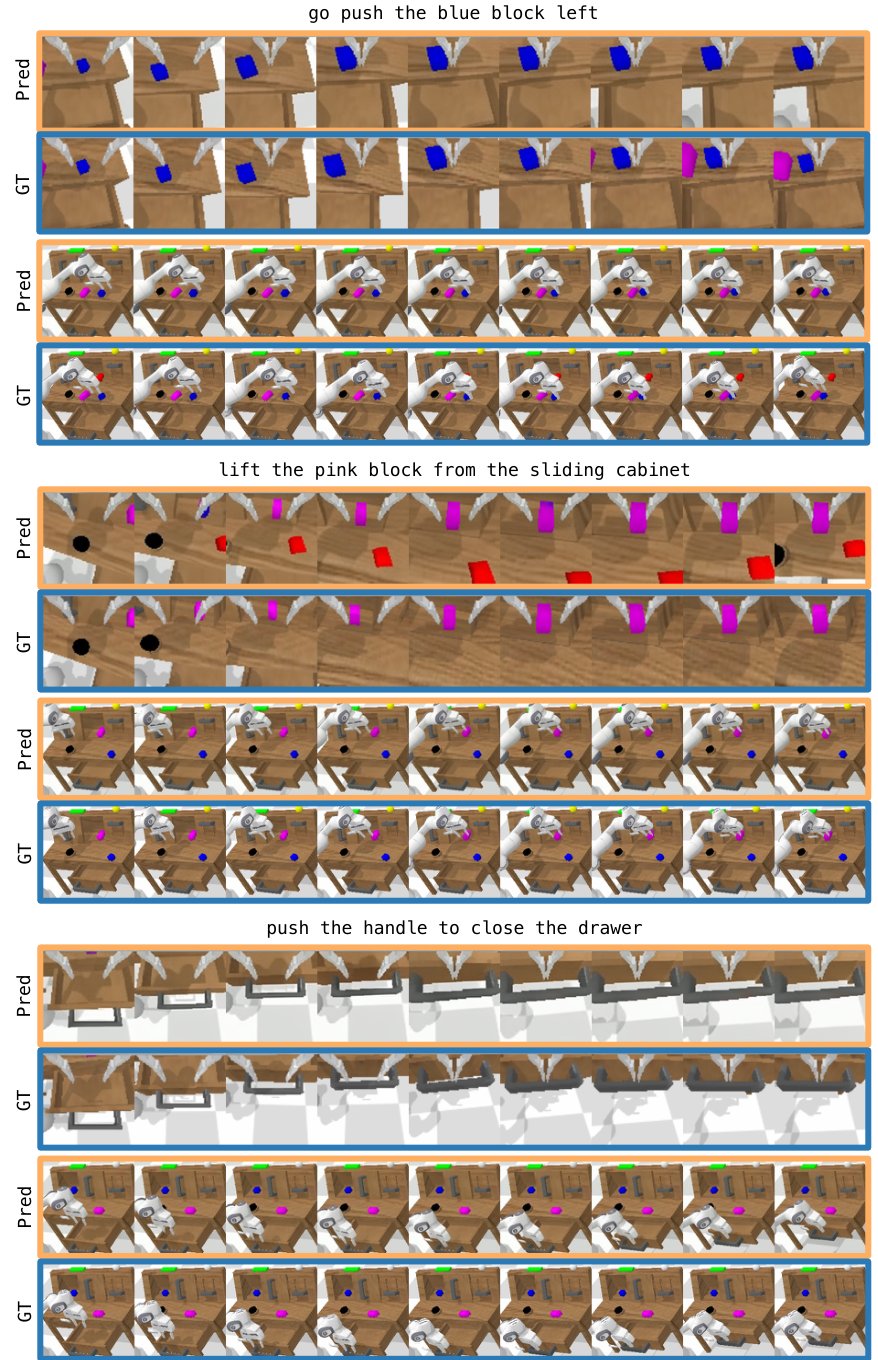

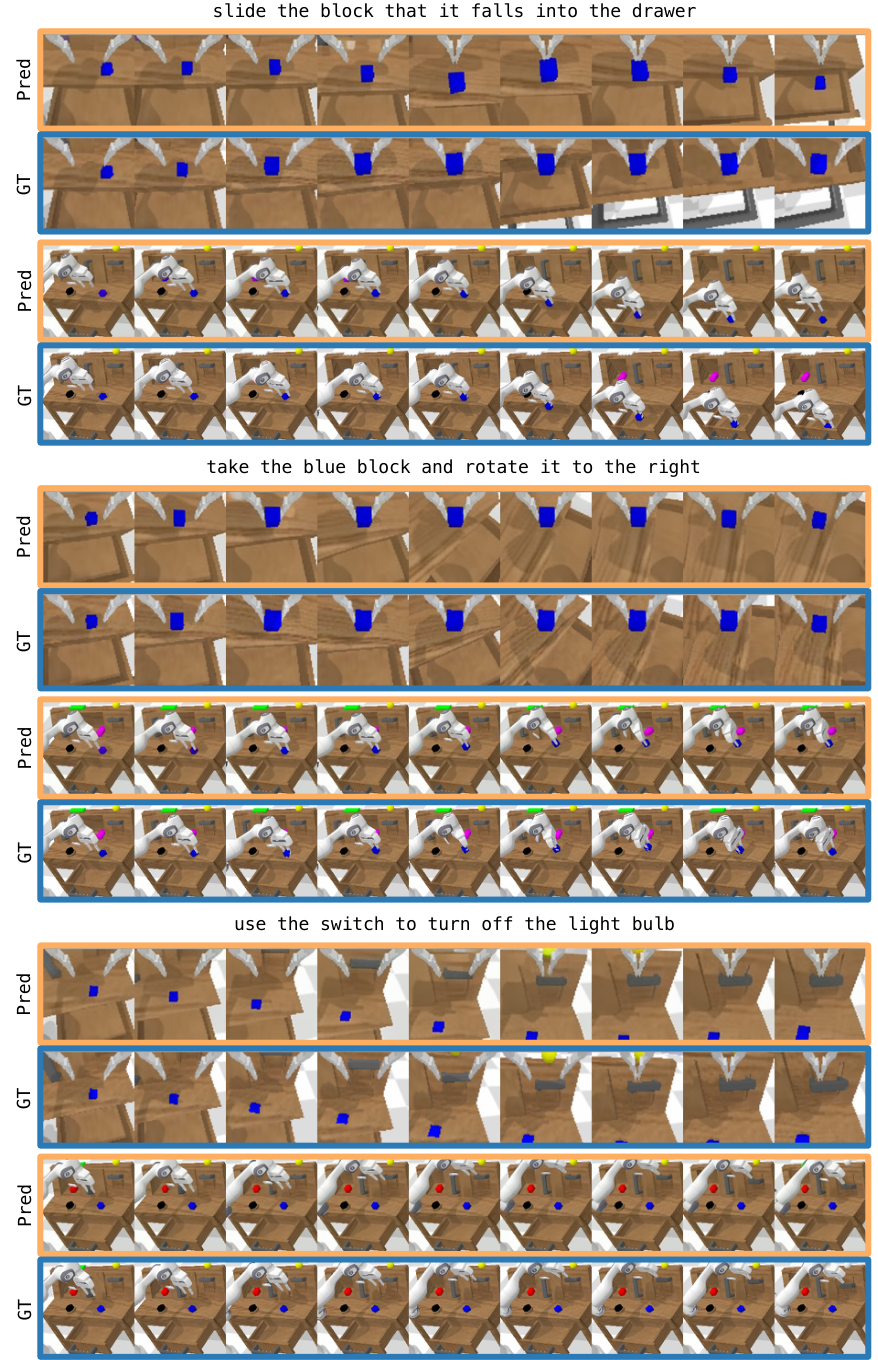

5.5 Autoregressive Video Generation

这一实验部分不是只展示“视频好看”,而是用于说明模型输出的 future video 与真实 rollout 对齐。作者给出的解释是:动作预测像是在“replay”模型自己预测的视频轨迹;因此持续改进 video generation 可能成为改进 action prediction 的路径。

5.6 Scaling

作者预训练了四种模型规模:GR-2-S、GR-2-B、GR-2-L、GR-2-XL,对应 trainable parameters 为 30M、95M、312M、719M。Figure 17 显示在 Ego4D、RT-1 和机器人数据验证集上 video prediction validation loss 随模型规模下降;fine-tuning 后真实机器人 success rate 也随规模提升。论文据此说明 GR-2 在 video generation 与 action prediction 两端都有 scaling trend。

6. 论文内分析与讨论

6.1 作者给出的结果解释

- 视频预训练帮助动作预测。作者把视频视为环境动态和文本条件下状态演化的来源;预训练后模型在 robot fine-tuning 中能把这种动态先验迁移到动作预测。

- 多视角和轨迹输出对真实机器人重要。GR-2 处理 head/hand 两个视角,并输出 action trajectory;论文称轨迹输出相对于 single-step action 对平滑和实时性能更关键。

- 数据增强改善 unseen generalization。在多任务实验中,GR-2 w/ DA 在 Unseen Environments 达到 87.0%,并在三个 generalization settings 上平均 74.7%。

- 视频预测与动作预测相关。作者观察到 generated video 与真实 rollout 对齐,并认为动作像是在执行预测视频中的轨迹。

6.2 作者明确写出的失败与未来方向

论文明确指出 Unseen Manipulation 仍然困难。典型失败包括无法抓取新形状的未见物体,以及在指令要求抓取未见物体时错误选择其他物体。Conclusion 中作者把未来方向聚焦在提升 action prediction 对 unseen manipulation 的泛化能力和鲁棒性。

7. 分析、局限与边界

7.1 这篇论文最有价值的地方

从论文自身证据看,最核心价值在于把 web-scale text-video generative pre-training 和 real-robot action trajectory learning 做成同一条训练链路,并且不是只在模拟或小规模任务中验证。作者用 38M 视频预训练、105 个真实桌面任务、94K bin-picking 轨迹、CALVIN 长序列 benchmark 和模型 scaling 共同支撑这一设计。

7.2 结果为什么站得住

论文结果的支撑来自四类互补评估:第一,多任务真实机器人实验覆盖 Simple、Distractor 和三类 OOD setting;第二,bin picking 对 seen/unseen/cluttered 物体做工业式评估;第三,CALVIN 提供公共 benchmark 对比;第四,scaling 曲线同时检查 video generation loss 与 robot success rate。关键数值不是单一指标:97.7%、79.0%、85.9%、4.64、74.7% 分别对应不同任务形态。

7.3 作者自述局限

- Unseen Manipulation 仍弱于其他设置。正文报告 GR-2 在 Unseen Manipulation 为 55.8%,并列出抓取新形状物体失败和选错未见目标物体两类失败。

- 未来仍需提升 action prediction 鲁棒性。Conclusion 明确将未来方向放在更强泛化和更稳健的动作预测,尤其是 unseen manipulation。

- 论文没有提供附录。无附录 因此完整超参、模型层数、loss 权重、cVAE 细节、WBC 优化目标和训练工程细节没有在源码文本中完整展开。

7.4 适用边界

GR-2 的实验边界主要是语言条件视觉操作、桌面真实机器人、bin picking、CALVIN 模拟长序列任务。论文没有证明该方法能直接迁移到不同机械臂形态、移动操作、大范围导航、强接触装配或需要精细力控的任务;WBC 部分说明了真实部署考虑 collision 和 manipulability,但没有给出完整控制算法推导。

8. 可复现性审计

| 复现要素 | 论文给出的信息 | 审计状态 |

|---|---|---|

| 论文源码与图表 | arXiv 提供 LaTeX 源码;本报告已从源码提取并转换所有独立图像。 | 可检查 |

| 数据 | 预训练数据来源和规模给出:HowTo100M、Ego4D、SSV2、EPIC-KITCHENS、Kinetics-700、RT-1、Bridge,总计 38M clips;真实机器人多任务 40K 轨迹,bin picking 94K 轨迹。 | 部分可复现;自采数据未公开 |

| 模型结构 | GPT-style transformer、frozen text encoder、frozen VQGAN、state linear layers、cVAE action trajectory head;默认模型 230M 参数,95M trainable。 | 中等;缺少完整层级配置 |

| 训练目标 | 预训练预测未来图像 token;fine-tuning 同时预测未来图像和 action trajectory。 | 目标清楚;loss 权重和训练 schedule 缺失 |

| 部署 | Kinova Gen3 + Robotiq 2F-85,head/hand cameras,WBC 以 200 Hz 执行 joint actions。 | 系统描述清楚;WBC 公式和工程细节不足 |

| 代码 | 论文和 arXiv 元数据只给 Project Page;本次检索未发现官方 GitHub 代码仓库。 | 代码不可直接复现 |