World Action Models are Zero-shot Policies

1. 论文速览

DreamZero,把预训练视频扩散模型改造成同时预测未来视频和动作的 World Action Model,并声称这种“视频世界建模 + 动作联合生成”的路线比现有 VLA 更擅长从异构、非重复机器人数据里学到可泛化的物理技能,甚至能在零样本任务和跨 embodiment 迁移上取得显著收益。

难度评级:★★★★☆

需要熟悉视频扩散模型、flow matching、inverse dynamics、闭环控制系统优化,以及 VLA / WAM 的建模差异。

关键词

核心贡献清单

- 提出

DreamZero:一个 14B 的 WAM,联合预测未来视频和动作,强调它能从异构、非重复的真实机器人数据里学到广泛技能。 - 提出方法论主张:WAM 相比 VLA 的优势不只是“多一个视频分支”,而是把动作学习转化成“从未来视觉计划中恢复动作”的隐式 inverse dynamics。

- 提出一整套实时推理优化:系统级、实现级和模型级加速,把 14B 视频扩散控制模型从 5.7 秒/块压到约 150ms/块,给出 38x 加速和 7Hz 闭环控制。

- 展示两类跨 embodiment 迁移:只用 10-20 分钟的视频示范做 robot-to-robot / human-to-robot transfer,以及 30 分钟 play data 做 few-shot 新 embodiment 适配。

2. 动机

2.1 要解决什么问题

作者认为,当前机器人 foundation model 的主流路线是 VLA:把预训练 VLM 扩展到动作输出。这条路线很擅长语义泛化,例如看懂复杂语言、识别新物体、把“what to do”对齐到语言知识;但它不擅长“how to do”,也就是新的物理动作、环境变化和精细运动控制。论文开头给的典型反例是:VLA 可以理解“把可乐罐移到 Taylor Swift 那里”,因为它知道 Taylor Swift 是谁、在哪里;但如果机器人数据里从未有过“untie the shoelace”,VLA 往往不会自己长出这个新动作。

因此论文想解决的不是单纯的“多任务机器人控制”,而是更尖锐的问题:机器人基础模型能否在没有专门收集大量重复演示的前提下,从更像现实世界的数据分布中学到新技能,并在新任务、新环境、甚至新 embodiment 上零样本泛化。

2.2 已有方法的局限

- VLA 的预训练偏静态语义:VLM 在静态图文上学到的是语义概念,不是精确时空动力学。作者明确说,这让它们缺乏动作执行时的几何、动力学和 motor control 表征。

- VLA 往往依赖大量、重复、任务中心的数据:要想在机器人上表现稳定,现有 VLA 往往需要很多 embodiment-specific robot data,而且这些数据通常是大量重复示范。

- 旧的 WAM 还没有把泛化潜力完全挖出来:已有视频-动作联合模型证明了世界建模目标有帮助,但不少工作仍然在重复演示场景里验证,或者没有系统研究数据多样性、架构形态和实时推理。

- 视频模型直接用于闭环控制很慢:视频扩散本身要多步去噪,参数量又大,天然不适合毫秒级反应式控制。作者把这一点单独作为三大核心挑战之一。

2.3 本文的解决思路(高层次)

DreamZero 的主张是:与其让模型直接做“观察到动作”的纯行为克隆,不如让它同时预测未来世界状态和动作,把动作学习变成一种由视觉未来引导的隐式 inverse dynamics。直觉上,如果模型已经能很好地想象“接下来世界应该长成什么样”,那么把这个未来视觉计划翻译成动作,应该比从当前观测直接回归动作更容易泛化。

为此,作者用预训练视频扩散模型做 backbone,让模型在给定语言、视觉历史和本体状态时,联合生成未来视频和动作;同时采用自回归视频生成、teacher forcing、KV cache 以及真实观测替换预测帧的闭环推理,避免纯视频 AR 里常见的误差积累问题。

3. 相关工作梳理

3.1 论文自述的相关工作

- Vision-Language-Action Models:论文把 RT 系列、OpenVLA、GR00T、π 系列等都归到这条线。它们把语言语义和动作输出放在同一个端到端模型里,但预训练先验主要来自静态图文。

- Video Model-based Robot Policies:一类是先生成视频再用 inverse dynamics / optical flow / planning 提取动作;另一类是直接做视频-动作联合生成。作者把后者统称为 WAM。

- 替代性 world model 架构:附录里作者还专门比较了 latent-space world model 和 3D point-cloud world model。作者认为这些方案多是学 $p(s_{t+1}\mid s_t,a_t)$,部署时还要配逆动力学或显式搜索;WAM 则直接学联合分布并输出动作轨迹。

3.2 直接前作对比

| 维度 | VLA | 传统 world model / latent world model | 已有 WAM | DreamZero |

|---|---|---|---|---|

| 预训练先验 | 静态图文 VLM | 常从头学动态 | 部分工作已使用视频扩散 | Wan2.1 I2V-14B 预训练视频扩散 |

| 学习目标 | 多为直接动作预测 | 学 forward dynamics,再额外规划/反解动作 | 视频与动作联合或耦合 | 联合视频与动作,强调隐式 inverse dynamics |

| 数据偏好 | 偏向大量重复、结构化演示 | 依任务而异 | 通常仍以机器人数据为主 | 强调异构、非重复、真实长时序数据也可用 |

| 推理方式 | 通常快 | 常需 MPC / search | 速度和闭环能力差异较大 | 通过异步执行 + 缓存 + Flash 训练实现 7Hz |

| 论文声称优势 | 语义泛化强 | 显式规划性强 | 视频先验可提升泛化 | 对 unseen motion / environment / embodiment 更强 |

4. 方法详解

5.1 方法概览

DreamZero 的计算图可以按“输入组织、联合建模、闭环执行、实时优化”四层理解:

- 输入:视觉历史 $\mathbf{o}_{0:l}$、当前 proprioception $\mathbf{q}_l$、语言指令 $\mathbf{c}$。

- 模型:预训练视频扩散 backbone + 少量新增的 state encoder、action encoder、action decoder。

- 目标:联合预测未来视频 chunk $\mathbf{o}_{l:l+H}$ 和动作 chunk $\mathbf{a}_{l:l+H}$。

- 部署:动作块异步执行,执行后把真实观测重新写进 KV cache,取代模型刚才生成的视觉未来,从而防止视频 AR 的误差滚雪球。

5.2 方法演变脉络

5.3 核心设计与数学推导

公式 1 说明 DreamZero 其实是在学一个联合分布:未来视频和未来动作一起生成,而这个联合分布可以看成“视频预测 × inverse dynamics”的乘积。

$$ \pi_0(\mathbf{o}_{l:l+H}, \mathbf{a}_{l:l+H}\mid \mathbf{o}_{0:l}, \mathbf{c}, \mathbf{q}_l) = \pi_0(\mathbf{o}_{l:l+H}\mid \mathbf{o}_{0:l}, \mathbf{c}, \mathbf{q}_l) \cdot \pi_0(\mathbf{a}_{l:l+H}\mid \mathbf{o}_{0:l+H}, \mathbf{q}_l) $$

| $\mathbf{o}_{0:l}$ | 到当前时刻为止的视觉历史。 |

| $\mathbf{o}_{l:l+H}$ | 未来一个 horizon 内的视频观测。 |

| $\mathbf{a}_{l:l+H}$ | 对应 horizon 内的动作块。 |

| $\mathbf{c}$ | 语言指令。 |

| $\mathbf{q}_l$ | 当前 proprioceptive state。 |

公式 2 和 3 是标准 flow matching 训练,但做成了 chunk-wise joint denoising:视频和动作在每个 chunk 上一起加噪、一起预测速度。

$$ \mathbf{z}_{t_k}^{k}=t_k\mathbf{z}_{1}^{k}+(1-t_k)\mathbf{z}_{0}^{k}, \qquad \mathbf{a}_{t_k}^{k}=t_k\mathbf{a}_{1}^{k}+(1-t_k)\mathbf{a}_{0}^{k} $$

$$ \mathcal{L}(\theta)= \mathbb{E}_{\mathbf{z},\mathbf{a},\{t_k\}} \Bigg[ \frac{1}{K}\sum_{k=1}^{K} w(t_k) \left\| \mathbf{u}_{\theta}([\mathbf{z}_{t_k}^{k},\mathbf{a}_{t_k}^{k}];\mathcal{C}_k,\mathbf{c},\mathbf{q}_k,t_k) -\mathbf{v}^{k} \right\|^2 \Bigg] $$

| $\mathbf{z}_1^k, \mathbf{a}_1^k$ | 第 $k$ 个 chunk 的干净视频 latent 和干净动作。 |

| $\mathbf{z}_0^k, \mathbf{a}_0^k$ | 标准高斯噪声。 |

| $\mathcal{C}_k$ | teacher forcing 的 clean 历史上下文,也就是前面所有 chunk 的真实 latent。 |

| $\mathbf{u}_\theta$ | 联合视频-动作 DiT,输出速度向量。 |

| $\mathbf{v}^k$ | 目标速度,即干净样本减噪声样本。 |

Flash 的核心不是“少去噪几步”这么简单,而是把训练分布改成:动作要学会在视频仍然很脏时先收敛到接近干净的值。

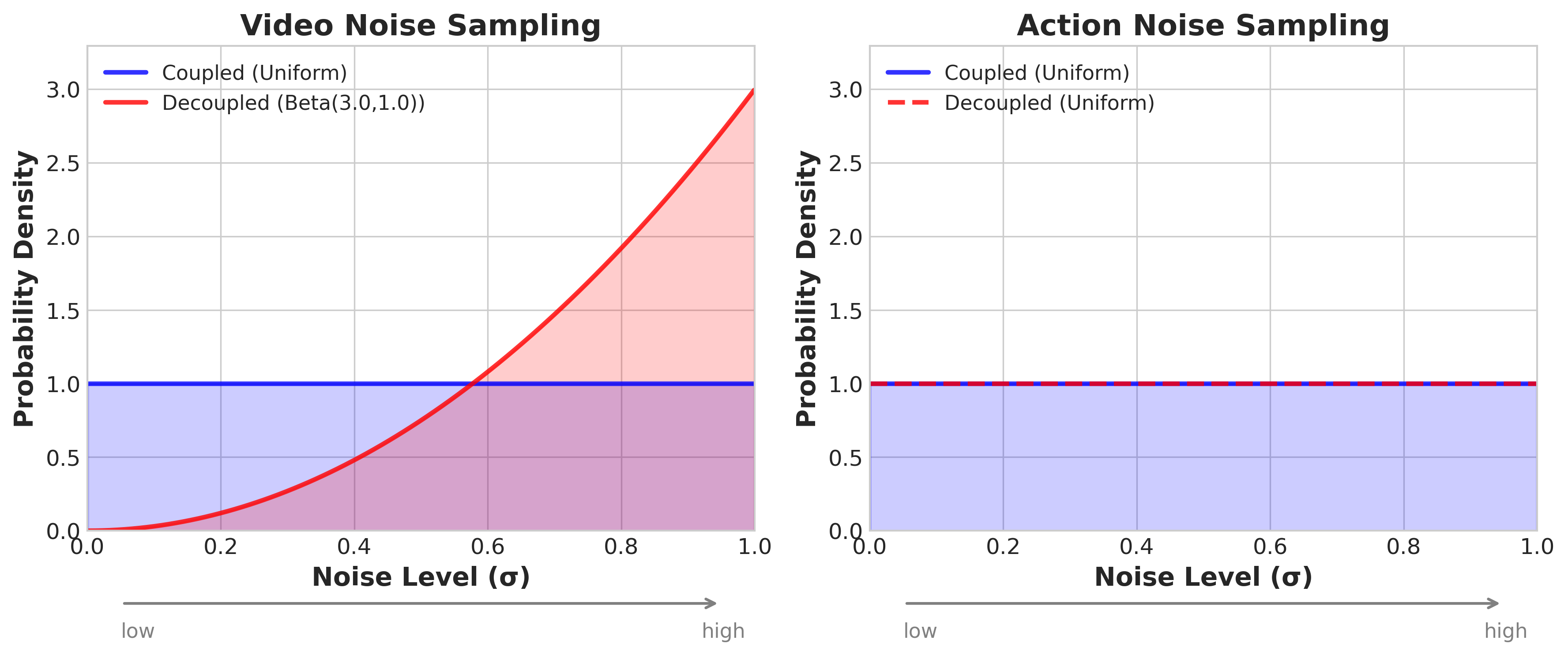

标准 DreamZero: $$ t_k^{\text{video}} = t_k^{\text{action}} = t_k,\quad t_k\sim\mathcal{U}(0,1) $$

DreamZero-Flash: $$ t_k^{\text{video}} = 1-\eta,\quad \eta\sim\text{Beta}(\alpha,\beta),\quad t_k^{\text{action}}\sim\mathcal{U}(0,1) $$

| 标准设置 | 视频和动作同噪声水平训练。 |

| Flash 设置 | 视频更多处于高噪声,动作保持均匀时间步。 |

| $\alpha=7,\beta=1$ | 论文示例配置,对应视频时间步均值约 0.125,即大多数训练样本的视频都很“脏”。 |

为什么这能提速

如果不改训练分布,1-step 推理时视频 latent 还在噪声区,动作分支依赖的视觉条件质量会很差。Flash 通过训练时就暴露这种“视觉很脏、动作要先准”的情况,使 1-step 动作生成仍能工作。

5.4 实现要点

- 多视角处理方式很朴素:多视角不是改 backbone 结构,而是把不同视角直接拼接成单帧送入视频模型。

- 只有视频是 AR,动作不是纯 AR rollout:作者说这样能避免 closed-loop action prediction 的误差传播,同时又保留 KV cache 带来的速度好处。

- chunk 设计与控制频率强绑定:AgiBot 是 5FPS 视频、30Hz 动作、48 步动作 horizon,每 chunk 正好 1.6 秒;DROID 是 5FPS 视频、15Hz 动作、24 步 horizon,同样 1.6 秒。上下文总长默认 4 个 chunk,对应 6.6 秒视觉历史。[附录 模型细节]

- 训练更新范围:更新所有 DiT blocks、state encoder、action encoder、action decoder;冻结 text encoder、image encoder 和 VAE。作者还专门提到 LoRA 试过但效果不佳。[正文 §4.1]

- 异步执行是必要条件:不是为了更快好看,而是为了把反应式约束从“推理必须先于动作”改成“推理只要在当前 action chunk 过期前完成”。作者给的目标延迟是低于约 200ms。

- action chunk smoothing:生成后的动作块先上采样 2x,再用 Savitzky-Golay 滤波,最后下采样回原分辨率,专门抑制高频抖动。[附录 实时执行]

5. 实验

6.1 实验设置

数据集与平台

| 平台 | 数据 | 规模 | 主要特点 |

|---|---|---|---|

| AgiBot G1 | 自采 teleoperation 数据 | 约 500 小时,7.2K episodes,22 个真实环境 | 强调整体异构性、长时序、多子任务;单 episode 平均 4.4 分钟、约 42 个 subtasks |

| DROID / Franka | DROID 公共数据 | 论文未在正文给总小时数,只强调其异构性高 | 用于证明 WAM 在公开多样化机器人数据上也有效,并支撑可复现性 |

| 跨 embodiment 数据 | YAM 双臂机器人视频;人类第一视角视频 | 各 72 条轨迹;YAM 约 20 分钟,人类约 12 分钟 | 只用视频目标,不用动作标签,测试 video-only transfer 的可行性 |

训练配置

| 设置 | AgiBot 预训练 | DROID 预训练 | 后训练 |

|---|---|---|---|

| backbone | Wan2.1-I2V-14B-480P | 从预训练 DreamZero checkpoint 继续 | |

| steps | 100K | 100K | 每下游任务 50K |

| global batch | 128 | 128 | 正文未单列;继承同类训练配置 |

| 更新参数 | 所有 DiT blocks + state/action encoders/decoder;冻结 text encoder、image encoder、VAE | ||

| 动作表示 | 默认使用 relative joint positions;过滤 idle actions | ||

基线

主要基线是两类 VLA:GR00T N1.6 和 π0.5。每个基线又分为两种初始化:

- from-scratch:只拿预训练 VLM 权重,不使用机器人预训练 checkpoint,和 DreamZero 做“苹果对苹果”的比较。

- from-pretrained:使用官方机器人预训练权重,再在作者数据上继续训练。

评测协议

- AgiBot seen tasks:10 个 seen 任务,4 台机器人,每任务 8 次 rollout,共 80 次 / checkpoint;分成 PnP Easy、PnP Hard、Contact-Rich 三类。[附录 AgiBot Eval]

- AgiBot unseen tasks:10 个训练分布外任务,如 untie shoelaces、ironing、painting、shake hands、pulling cart 等,同样 80 次 / checkpoint。[附录 AgiBot Eval]

- DROID:20 个 seen 任务 + 20 个 unseen-verb 任务,每任务 2 次 rollout,总 80 次;指标同时看 task progress 和 success rate。[附录 DROID Eval]

- 后训练任务:shirt folding、fruit packing、table bussing;每任务 10 次 rollout,指标是 task progress。

附录中给出的任务清单

| 评测集 | 任务概览 |

|---|---|

| AgiBot seen | PnP Fruit、Taking out Fruit、Wipe the Mess、PnP Fork/Spoon、Put Pen in Holder、Put Cup on Coaster、Stack Bowls/Cups、Folding Shirts、Folding Shorts、Stacking Clothes |

| AgiBot unseen | Untie Shoelaces、Remove/Put Hat、Draw Circle、Take out Straw、Cube Stacking、Painting、Ironing、Shake Hands、Folding (Map)、Pulling Cart |

| DROID seen | 例如 put marker in box、remove gloves from drawer、put bread into toaster、push toaster lever、pick up apple and put in basket 等 20 个日常操作 |

| DROID unseen verbs | Orient、Fan、Slice、Type、Extricate、Reveal、Match、Maneuver、Affix、Combine、Hook、Pinch、Withdraw、Cinch、Dispense、Bake、Fry、Depress、Elevate、Weave |

6.2 主要结果

Q1:是否能从异构、非重复数据里学好策略?

作者首先在 AgiBot seen 任务上看零样本环境泛化。核心结论是:DreamZero 的平均 task progress 达到 62.2%,而最佳 pretrained VLA baseline 只有 27.4%;from-scratch VLA 几乎接近零。作者把这个结果解释为:WAM 借助视频预测先验,不需要从稀疏状态-动作对应里硬学动力学,因此更能消化异构数据。

Q2:是否能零样本泛化到未见任务?

AgiBot unseen 任务上,DreamZero 平均达到 39.5% task progress,而 pretrained VLA baseline 是 16.3%,from-scratch VLA 低于 1%。作者特别提到 Remove Hat from Mannequin 有 85.7%,Shake Hands 有 59.2%。

DROID 设置下,DreamZero 也明显领先:49% task progress、22.5% success rate;GR00T N1.6 是 31% / 12.5%,π0.5 是 33% / 7.5%。这里作者强调的是 unseen verbs,也就是命令中的动词本身没有出现在训练集中。

Q3:task-specific post-training 后,泛化是否还能保留?

作者在 shirt folding、fruit packing、table bussing 三个任务上做 post-training。论文没有在正文给出每个方法的精确数字表,但图中结论很明确:DreamZero 在三个任务上都至少匹配 VLA,fruit packing 上明显更好。作者用这组实验支撑“环境泛化在 task-specific post-training 后并没有消失”。

Q4:video-only 跨 embodiment transfer 是否有用?

| 方法 | 平均 unseen-task progress |

|---|---|

| DreamZero | 38.3% ± 7.6% |

| DreamZero + Human2Robot transfer | 54.3% ± 10.4% |

| DreamZero + Robot2Robot transfer | 55.4% ± 9.5% |

只加 10-20 分钟的 video-only 示范,就能把 unseen 任务平均进度从 38.3 拉到 54 左右,提升相对比例超过 42%。作者认为这是 WAM 的一个独特扩展方向:它可以用大量没有动作标签的人类视频继续提高 world model 的任务理解。

Q5:few-shot 新 embodiment adaptation 是否可行?

作者把 DreamZero-AgiBot checkpoint 用 约 30 分钟、55 条轨迹、11 个任务 的 YAM play data 做后训练,展示了在新双臂机器人上仍保留语言跟随和一定的零样本能力。这里结果主要是定性展示,没有像前几节那样给数值表,但这部分的论点是:如果动作学习主要是从未来视频反解动作,那么迁移到新 embodiment 时,模型只需要少量数据去校准“视觉未来到动作”的映射。

Q6:Flash 能否在少步去噪时保住性能?

| 方法 | 去噪步数 | Task Progress | Inference Speed | 加速比 |

|---|---|---|---|---|

| DreamZero | 4 | 83% ± 6.1% | 350ms | 1x |

| DreamZero | 1 | 52% ± 10.2% | 150ms | 2.33x |

| DreamZero-Flash | 1 | 74% ± 10.1% | 150ms | 2.33x |

这里的关键信息是:直接把 DreamZero 从 4 步压到 1 步,性能掉很多;而 Flash 训练能把 1-step 性能拉回大部分,从 52% 回到 74%。所以 Flash 的价值不只是更快,而是让“极少步数推理”成为一个可训练的工作点。

6.3 消融实验

| 问题 | 设置 | 结果 | 作者结论 |

|---|---|---|---|

| 数据多样性 | 同样 500 小时,repetitive vs diverse | 33% → 50% | 对 WAM 来说,异构数据明显优于重复数据 |

| 模型规模 | DreamZero 5B vs 14B | 21% vs 50% | WAM 明显随视频 backbone 规模上升 |

| VLA 扩大规模 | VLA 5B / 14B | 都约 0% | 单纯加大 VLA 容量不能解决异构数据学习问题 |

| 架构 | bidirectional vs autoregressive | task progress 都是 50% | AR 在平滑性和速度上更优,虽然最终进度接近 |

这组消融非常直接地支撑了论文的三条方法论主张:数据必须多样、模型要大、自回归更适合闭环 WAM。

6.4 补充实验与实时执行细节

实时执行速度来源

| 优化项 | H100 | GB200 |

|---|---|---|

| Baseline | 1x | 1.1x |

| + CFG Parallelism | 1.9x | 1.8x |

| + DiT Caching | 5.5x | 5.4x |

| + Torch Compile + CUDA Graphs | 8.9x | 10.9x |

| + Kernel & Scheduler Opts | 9.6x | 14.8x |

| + Quantization (NVFP4) | 不适用 | 16.6x |

| + DreamZero-Flash | 不适用 | 38x |

作者给出的整体延迟叙事是:naive 单 GPU DreamZero 需要约 5.7 秒 / action chunk,而在 GB200 上叠加所有优化后可以降到约 150ms / chunk,从而满足异步执行下的 7Hz 闭环控制。

6. 分析与讨论

7.1 论文原文已经给出的解释

- 作者把 DreamZero 的优势归因于“视频预测提供强先验”,而不是简单的模型更大。尤其在异构数据上,WAM 不需要像 VLA 那样从 noisy state-action pairs 里硬学动作规律。

- 作者反复强调:DreamZero 的动作和视频预测高度对齐,因此失败往往不是“动作 decoder 出错”,而是“视频计划先错了”。这也是为什么他们认为提升视频 backbone 能直接提升策略质量。

- 跨 embodiment transfer 的收益,被作者解释成“世界模型先学任务 dynamics,动作映射只需少量新 embodiment 数据去重新对齐”。

- AR 和 bidirectional 在 task progress 上接近,但 AR 更平滑、更快。作者因此认为 WAM 的核心收益不仅是最终成功率,还包括视频-动作-语言对齐的工程可用性。

7.2 作者自述的局限性

限制 1:推理依然昂贵。 即便做完优化,DreamZero 也要 2 台 GB200 才能实现 7Hz;和能在消费级 GPU 上跑到 20Hz 以上的 VLA 相比,部署门槛仍高。

限制 2:长时记忆仍短。 当前可用视觉上下文只有约 6.6 秒,离真正长时任务还远。

限制 3:高精度任务仍难。 作者承认,像 key insertion、精细装配这类需要亚厘米精度的任务,对行为克隆类方法仍然困难。

限制 4:规模定律尚不清楚。 论文只给了有限的 5B vs 14B 和 diverse vs repetitive 消融,还不足以支撑 WAM 的完整 scaling law。

7.3 失败案例与适用边界

- DreamZero 现在最强的边界是:开放环境、未见动作、跨 embodiment。这是论文真正想证明的主战场。

- 它不是显式规划器,不做 test-time MPC / MPPI;它依赖的是联合视频-动作生成本身带来的隐式视觉规划。

- few-shot embodiment adaptation 的结果仍然主要是定性,说明这个方向有潜力,但还不是完全成熟的量化结论。

- 作者特别指出,若未来能接入更大规模 egocentric human video,WAM 的上限可能远高于当前实验所示,因为视频数据规模天然远大于动作标注机器人数据。